修了門 VFX 課程,作業之一是透過製作一小段 CG + live shooting 的片段來了解 matchmoving 與 camera tracking 的過程與細節。我挑選了 NukeX,使用裏頭的 CameraTracker 來處理這件事。

CameraTracker 本身建議的 feature points 個數不多,只要 100~200 就差不多了,它預覽用的 feature points 品質就挺不錯的了,而且非常的快,對於一個 VFX toolset 來說,這方面的表現非常的好。 VFX 裏頭,有非常多的方法與演算法,都足以耗去你數十分鐘,有日甚至要數小時,這對於工作排得滿滿的,一路到天花板的工作人員來說,無疑是一種災難。有非常多的 studio 花了很多的力氣在處理的技術問題中,「時間/效能」這部分佔了很高的比例。(整合是另一大塊,不過不在這篇 blog 的範圍)Nuke 能在 compositing 勝出的原因之一,我想重點就是「效能」。

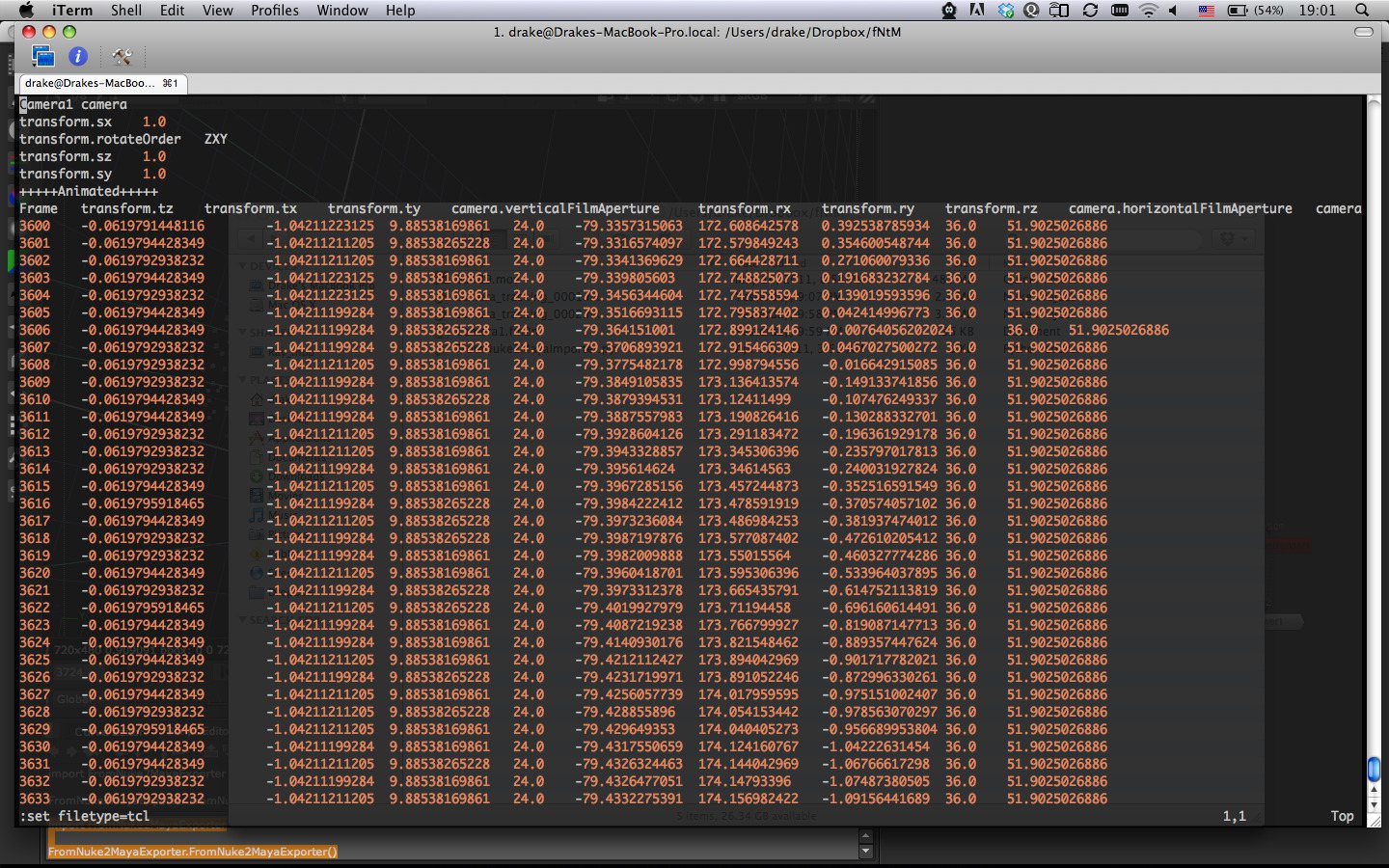

上頭的四張截圖,純脆是覺得有趣好玩的,並沒有任何技術意義。不管是 tracking 或是 camera/features 的 exporting to Maya,只要花些許時間,都能一一執行過去。問題就在於,當你手上拿到一組 tracking camera,還有一堆 feature point cloud 後,匯入 Maya,與裏頭的 CG element 混在一起,就算是比較麻煩的事了。我的經驗尚且不足,只完成了如下的小片段。

附記:

- pzman 有篇 [NukeX 6 : 從NUKE追蹤資料到MAYA&修Marker流程](http://NukeX 6 : 從NUKE追蹤資料到MAYA&修Marker流程),是個好的開始。